Huawei mejora la técnica Mixture of Experts para lograr mejor rendimiento con chips menos potentes

Huawei ha mostrado un nuevo avance en el desarrollo de modelos de lenguaje extensos (LLM) que desafía directamente las restricciones tecnológicas impuestas por Estados Unidos.

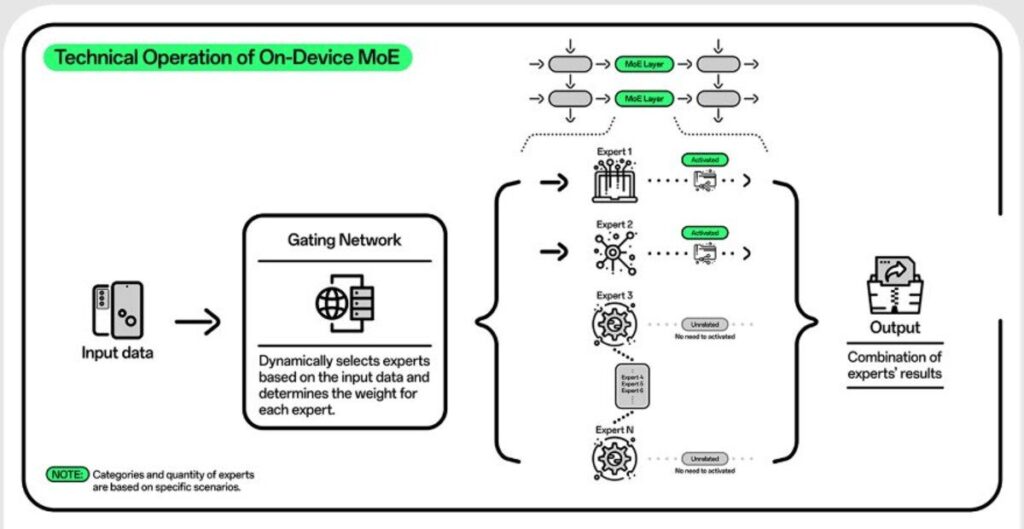

Oppo, primera marca de smartphones en integrar la arquitectura Mixture of Experts en sus equipos

Opppo ha anunciado un importante avance en el ámbito de la inteligencia artificial aplicada a dispositivos móviles, convirtiéndose en la primera compañía en implementar la arquitectura Mixture of Experts (MoE) en sus dispositivos.